Ahogy az AI-technológiával támogatott deepfake csalások egyre elterjedtebbé válnak, a biztonsági szakemberek arra figyelmeztetnek, hogy ez a támadási módszer a videókon és hangfelvételeken túl is terjedhet.

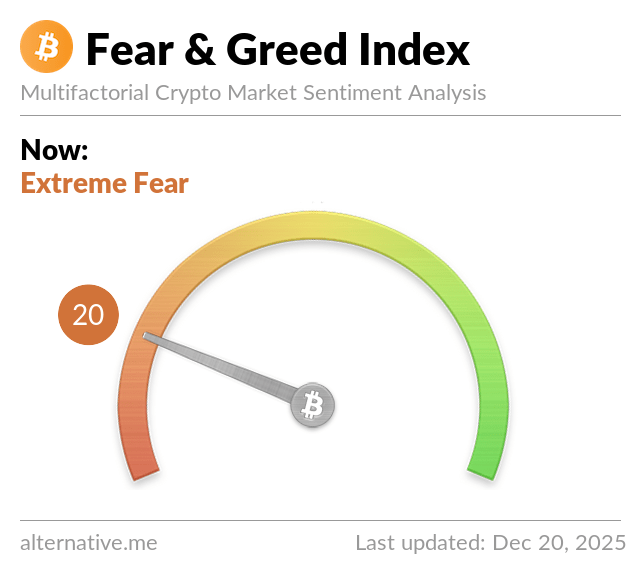

2024 második negyedévében a Gen Digital szoftvercég jelentése szerint a rosszindulatú szereplők felerősítették az AI-alapú deepfake csalásokat, amelyekkel kriptovalutát birtokló személyeket próbálnak megkárosítani. A „CryptoCore” nevű csalócsoport eddig több mint 5 millió dollárt csalt ki kriptovalutában AI deepfake technológiával.

Bár ez az összeg alacsonynak tűnhet más támadási módszerekhez képest a kripto világában, a biztonsági szakértők szerint az AI deepfake támadások egyre nagyobb veszélyt jelenthetnek, különösen a digitális eszközök biztonságára.

Az AI deepfake-ek veszélyeztetik a pénztárcák biztonságát

A Web3 biztonsági cég, a CertiK úgy véli, hogy az AI-alapú deepfake csalások egyre kifinomultabbá válnak. A CertiK szóvivője a Cointelegraphnak adott interjújában kifejtette, hogy ez a támadási módszer a jövőben a videókon és hangfelvételeken túl is kiterjedhet.

A szóvivő kifejtette, hogy például, ha egy pénztárca arcfelismerést használ az érzékeny információk védelmére, akkor meg kell vizsgálni, hogy mennyire ellenálló ez a megoldás az AI-vezérelt fenyegetésekkel szemben:

„Ha egy pénztárca arcfelismerésre támaszkodik a kritikus információk védelme érdekében, alaposan meg kell vizsgálnia, hogy megoldása mennyire robusztus az AI-vezérelt fenyegetésekkel szemben.”

Ez is érdekelhet: A legjobb kripto ICO projektek 2024

A szóvivő szerint fontos, hogy a kriptoközösség tagjai tisztában legyenek ezzel a támadási módszerrel, és megfelelően felkészüljenek rá.

Az AI deepfake-ek továbbra is fenyegetik a kriptopénz tulajdonosokat

Luis Corrons, a Norton kiberbiztonsági vállalat biztonsági evangélistája úgy véli, hogy az AI-alapú támadások továbbra is a kriptovalutákat birtoklókat célozzák meg. Corrons rámutatott, hogy a kriptovaluták jelentős pénzügyi nyereséggel járnak, miközben a kockázatok alacsonyabbak a hackerek számára:

„A kriptovaluta tranzakciók gyakran magas értékűek és anonim módon hajthatók végre, így vonzóbb célponttá válnak a kiberbűnözők számára, mivel a sikeres támadások jelentősebb pénzügyi jutalommal járnak, és alacsonyabb a felderítési kockázat.”

Corrons emellett kiemelte, hogy a kriptovaluták továbbra is szabályozások hiányában működnek, ami kevesebb jogi következményt jelent a kiberbűnözők számára, és több lehetőséget biztosít a támadások végrehajtására.

Hogyan lehet felismerni az AI-alapú deepfake támadásokat?

Bár az AI-alapú támadások komoly fenyegetést jelenthetnek a kriptovaluta tulajdonosok számára, a biztonsági szakemberek úgy vélik, hogy vannak módszerek, amelyekkel a felhasználók megvédhetik magukat. A CertiK szóvivője szerint az oktatás lenne a megfelelő kiindulópont.

Egy CertiK mérnök elmagyarázta, hogy fontos megérteni a fenyegetéseket, valamint ismerni az elérhető eszközöket és szolgáltatásokat, amelyekkel szembeszállhatunk ezekkel. Emellett hozzátette, hogy óvatosnak kell lenni a kéretlen pénzkérésekkel vagy személyes adatokra irányuló kérésekkel szemben.

„Kulcsfontosságú, hogy szkeptikusan kezeljük az ilyen kéréseket, és az érzékeny fiókok esetében többfaktoros hitelesítést alkalmazzunk, ami extra védelmi réteget biztosít az ilyen csalásokkal szemben” – magyarázta a szakember.

Ez is érdekelhet: A legjobb kriptovaluták 2024-ben

Corrons úgy véli, hogy a felhasználók különböző „vörös zászlókat” figyelhetnek meg, amelyek segíthetnek az AI deepfake csalások felismerésében. Ilyenek lehetnek a természetellenes szemmozgások, arckifejezések vagy testmozgások.

Ezen felül a szakember szerint az érzelem hiánya is fontos jel lehet: „Arra is érdemes figyelni, ha valaki arckifejezése nem tükrözi azt az érzelmet, amit az elhangzottak alapján mutatnia kellene.”

Továbbá a test alakjának furcsaságai, az elhangzott hang és a látott kép közötti eltérések, valamint egyéb hangbeli inkonzisztenciák is segíthetnek a felhasználóknak felismerni, ha egy AI deepfake támadás áldozatai lennének.

A kriptomagazin.hu oldalon található információk és elemzések a szerzők magánvéleményét tükrözik. A jelen oldalon megjelenő írások, cikkek nem valósítanak meg a 2007. évi CXXXVIII. törvény (Bszt.) 4. § (2). bek 8. pontja szerinti befektetési elemzést és a 9. pont szerinti befektetési tanácsadást. Bármely befektetési döntés meghozatala során az adott befektetés megfelelőségét csak az adott befektető személyére szabott vizsgálattal lehet megállapítani, melyre a jelen oldal nem vállalkozik és nem is alkalmas. Az egyes befektetési döntések előtt éppen ezért tájékozódjon részletesen és több forrásból, szükség esetén konzultáljon befektetési tanácsadóval!

A cikkekben megjelenő esetleges hibákért, téves információkból eredendő anyagi károkért a kriptomagazin.hu felelősséget nem vállal.

A cikkben előfordulhatnak partnerlinkek, amelyek után jutalékot kaphatunk.