Az Egyesült Államok hadserege állítólag az Anthropic által fejlesztett Claude mesterséges intelligencia-modellt használta egy Irán elleni nagyszabású légicsapás során – mindössze néhány órával azután, hogy Donald Trump elnök elrendelte a vállalat technológiáinak betiltását a szövetségi ügynökségek számára.

A Wall Street Journal információira hivatkozó források szerint az amerikai katonai parancsnokságok – köztük a Közel-Keleten működő US Central Command (CENTCOM) – operatív támogatásra vették igénybe a Claude AI-rendszert. Az eszköz kulcsszerepet játszott a hírszerzési adatok elemzésében, potenciális célpontok azonosításában, valamint harctéri szimulációk futtatásában az Irán elleni támadás során.

AI a modern hadviselés középpontjában

A jelentések rávilágítanak arra, hogy a fejlett mesterséges intelligencia-rendszerek milyen mélyen beépültek a modern védelmi infrastruktúrába. Annak ellenére, hogy az amerikai adminisztráció hivatalosan megszakította volna kapcsolatait az Anthropickal, a Claude modell továbbra is integrálva maradt katonai munkafolyamatokba.

A Pentagon korábban többéves, akár 200 millió dollár értékű szerződést kötött az Anthropickal, amely lehetővé tette, hogy a Claude rendszert minősített hírszerzési és operatív környezetben is használják – például célpontok kiválasztására vagy harci forgatókönyvek modellezésére.

In an exclusive interview with CBS News' @jolingkent, Anthropic CEO Dario Amodei said that the Pentagon’s decision to designate the AI company a supply chain risk is “retaliatory and punitive.”

The Pentagon made the designation, which restricts military contractors from doing… pic.twitter.com/IGOnztaOx0

— CBS News (@CBSNews) February 28, 2026

Sőt, a beszámolók szerint a modellt már korábbi műveletek során is bevetették, például egy 2026 januári venezuelai akcióban, amely Nicolás Maduro elfogásával végződött.

Miért tiltotta be Trump az Anthropicot?

A konfliktus hátterében az áll, hogy az Anthropic vezérigazgatója, Dario Amodei elutasította a Pentagon kérését, amely korlátlan katonai felhasználást követelt volna az AI-modellekre „bármilyen jogszerű forgatókönyv” esetén.

Amodei szerint bizonyos alkalmazási területek – például:

- tömeges megfigyelés,

- teljesen autonóm fegyverrendszerek,

- emberi döntéshozatalt kiváltó harci AI-megoldások

olyan etikai határokat lépnek át, amelyeket a vállalat nem hajlandó áthágni – még kormányzati szerződések elvesztése árán sem.

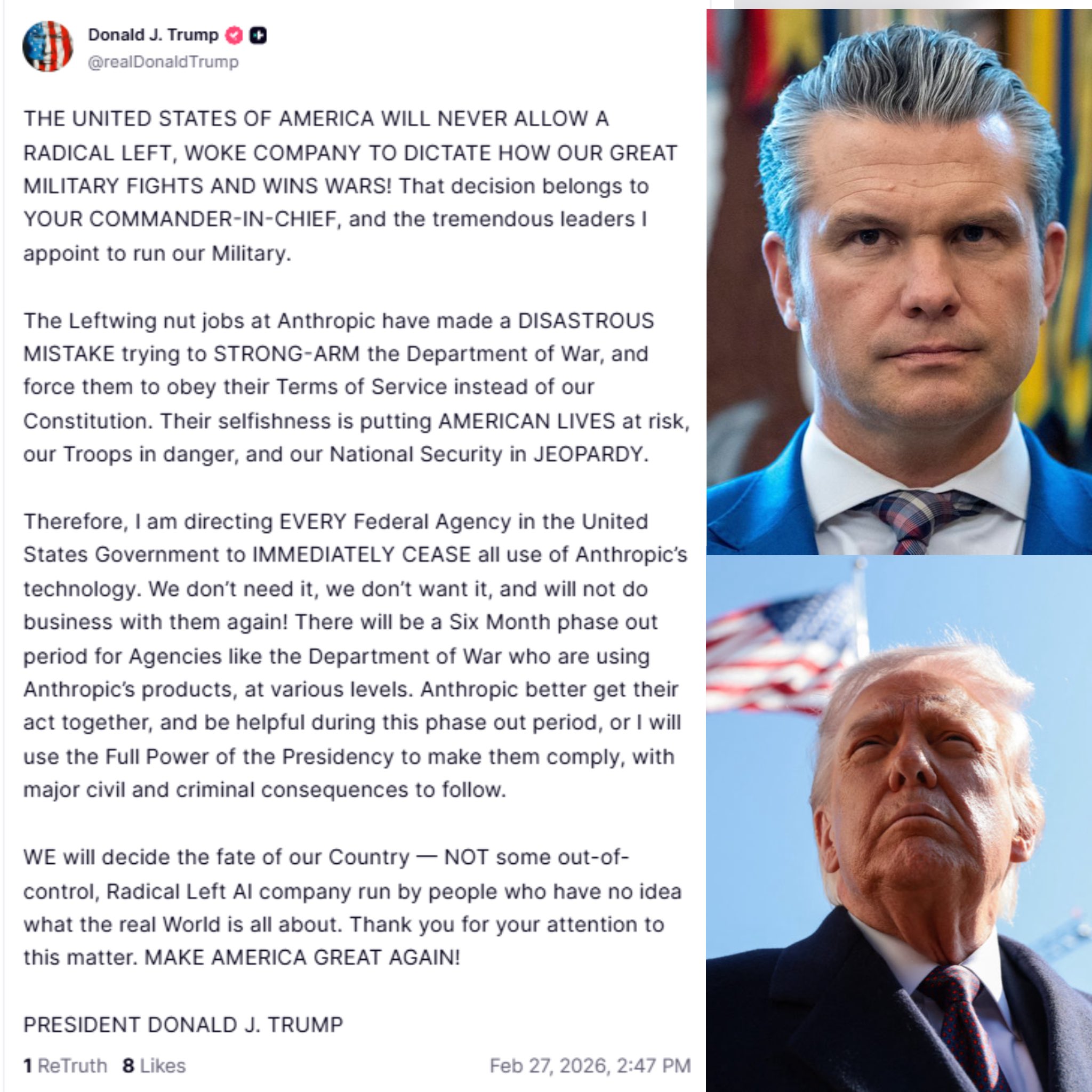

Ezt követően az amerikai védelmi minisztérium „nemzetbiztonsági ellátási lánc kockázatként” minősítette az Anthropicot, Trump pedig utasította a szövetségi ügynökségeket, hogy hagyjanak fel a cég technológiájának használatával, és kezdjék meg annak fokozatos kivonását.

Az OpenAI léphet az Anthropic helyére

A Pentagon már alternatív beszállítók után néz, és a hírek szerint megállapodást kötött az OpenAI-jal, hogy annak mesterséges intelligencia-modelljeit minősített katonai hálózatokon telepítsék.

Ez újabb vitákat indított el a mesterséges intelligencia hadászati felhasználásáról, különösen azzal kapcsolatban, hogy mennyire szabad a döntéshozatalt algoritmusokra bízni olyan kritikus helyzetekben, mint egy légicsapás célpontjainak kiválasztása.

Wait!

Anthropic says it is not ready to violate its core principles on domestic mass surveillance and autonomous weapon systems. Trump's Department of War threw them out.

Now, Sam says DoW agrees with these principles? 🤔— Sreemoy Talukdar (@sreemoytalukdar) February 28, 2026

A kriptomagazin.hu oldalon található információk és elemzések a szerzők magánvéleményét tükrözik. A jelen oldalon megjelenő írások, cikkek nem valósítanak meg a 2007. évi CXXXVIII. törvény (Bszt.) 4. § (2). bek 8. pontja szerinti befektetési elemzést és a 9. pont szerinti befektetési tanácsadást. Bármely befektetési döntés meghozatala során az adott befektetés megfelelőségét csak az adott befektető személyére szabott vizsgálattal lehet megállapítani, melyre a jelen oldal nem vállalkozik és nem is alkalmas. Az egyes befektetési döntések előtt éppen ezért tájékozódjon részletesen és több forrásból, szükség esetén konzultáljon befektetési tanácsadóval!

A cikkekben megjelenő esetleges hibákért téves információkból eredendő anyagi károkért a kriptomagazin.hu felelősséget nem vállal.